Настройка и проверка файлов robots.txt и sitemap.xml

В продвижении одним из важнейших этапов является технический аудит сайта, направленный на поиск критических ошибок, проверку корректности отображения на мобильных устройствах и скорости загрузки.

В рамках этого этапа наши специалисты обращают особое внимание на работу 2 файлов: robots.txt и sitemap.xml.

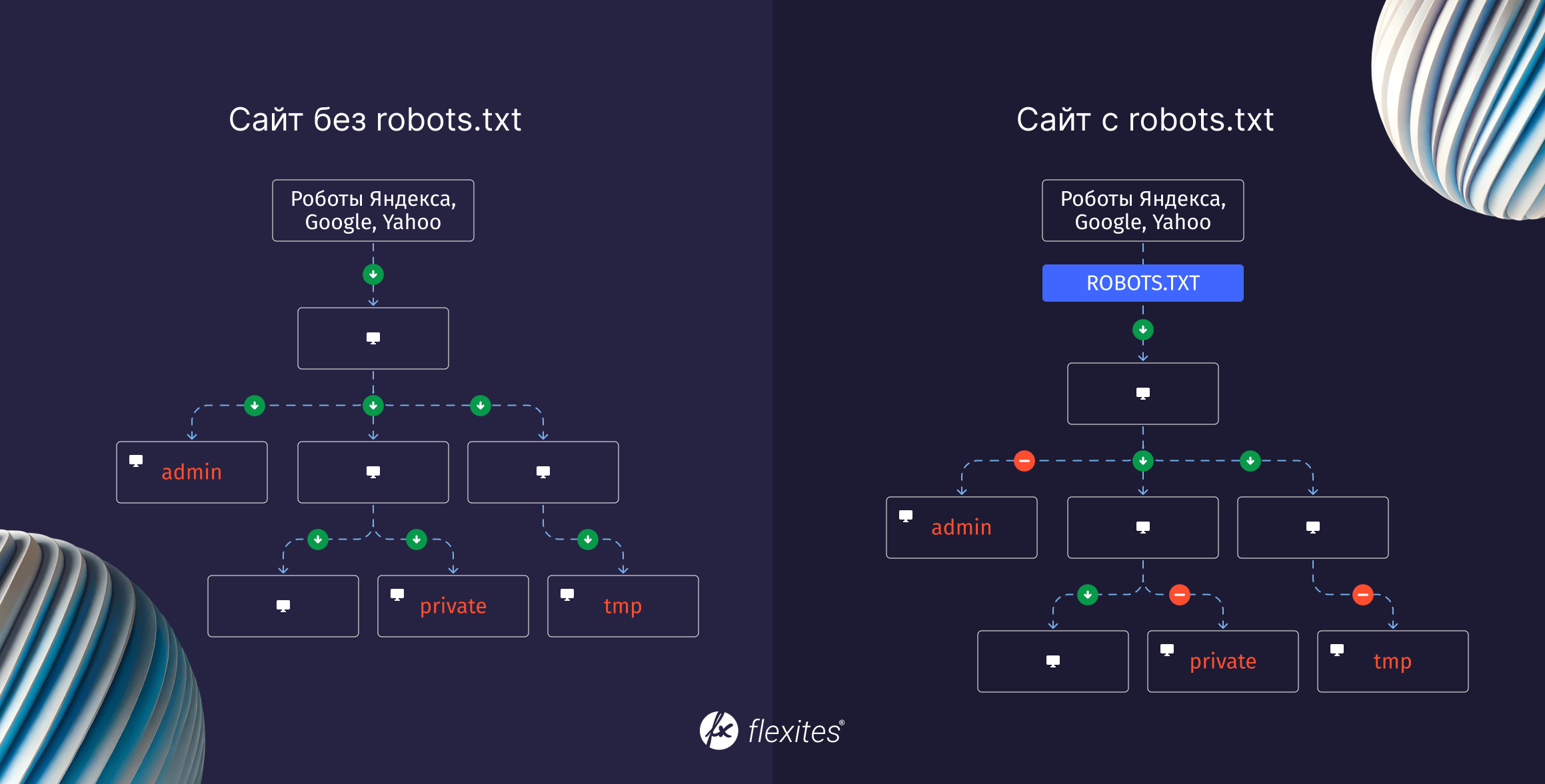

Правильная индексация сайта становится приоритетной задачей для владельца веб-ресурса. Чтобы избежать попадания ненужных страниц в индекс и сохранять высокие позиции в поисковой выдаче SEO-специалисты используют robots.txt — это файл управления индексацией, который подсказывает поисковым роботам (краулерам), какие разделы не стоит включать в индекс.

От индексации зачастую скрывают следующие страницы:

- Служебные страницы сайта, такие как admin или tmp;

- Приватные данные (страницы авторизации и регистрации, корзины, страницы оформления заказа);

- Дублирующие документы, которые нельзя исключить из структуры иным способом;

- Результаты поиска по сайту и другие.

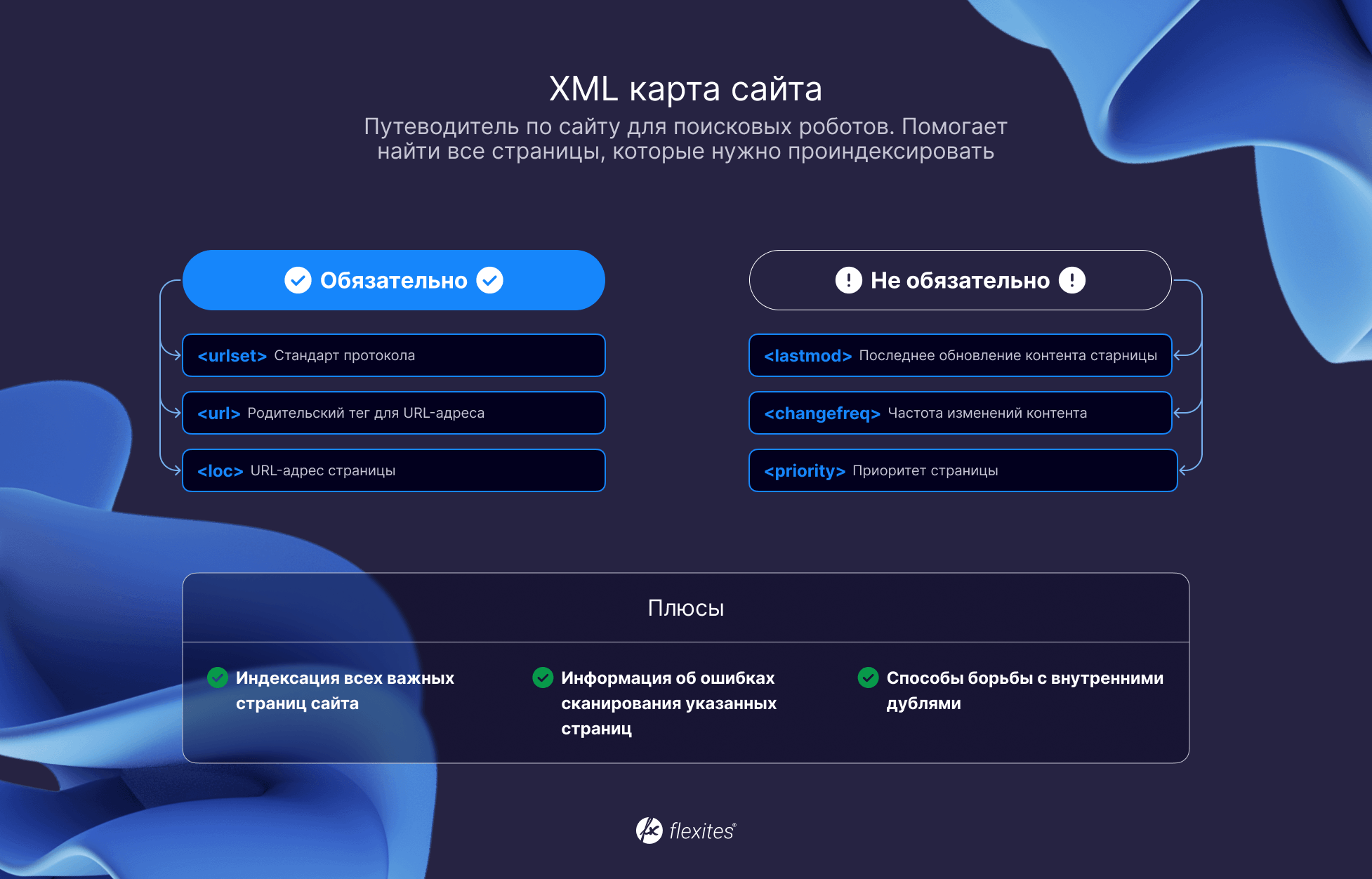

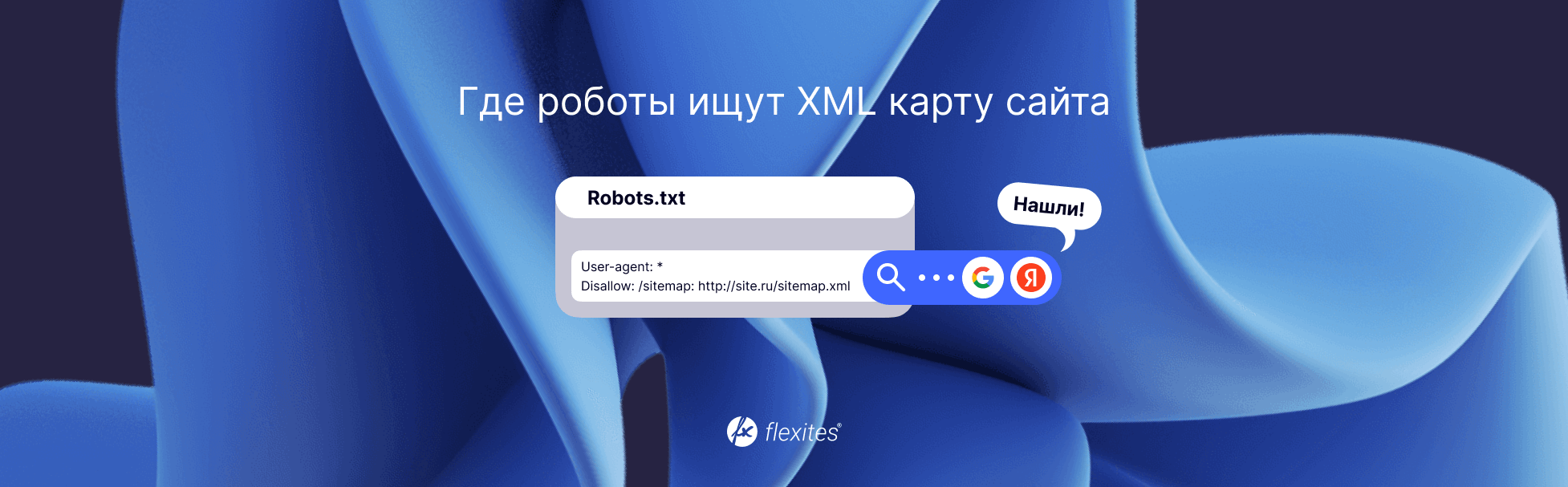

Не менее важным при настройке сайта является файл Sitemap.xml — это файл в формате XML, который содержит список всех важных URL-адресов и метаданные о них (например, дату последнего изменения, приоритет). Такой список адресов становится «маршрутной картой» для поисковых роботов, чтобы они могли более эффективно индексировать ресурс и улучшать видимость контента.

В первую очередь sitemap.xml используют те боты, которые не рендерят страницы и не переходят по всем ссылкам. Это делается для того, чтобы не упустить важные разделы при «обходе» сайта. Именно поэтому данный файл становится ключевыми инструментом SEO, который помогает поисковикам понять структуру ресурса (особенно многостраничных сайтов).

Зачем нужно выстраивать корректную работу robots.txt и sitemap.xml?

Есть несколько причин, по которым настройка этих файлов становится необходимой в продвижении:

- При публикации новой статьи или обновлении карточки товара вы получите ускоренную индексацию нового контента, то есть после отправки обновленной карты сайта робот придет по указанным ссылкам в течение нескольких часов, а не дней или недель;

- С помощью грамотной настройки этих файлов вы обеспечиваете гарантию обнаружения всех ключевых страниц. Особенно актуально проведение настройки robots.txt и sitemap.xml для многостраничных ресурсов, сайтов с плохой внутренней перелинковкой или новостных веб-ресурсов.

- Хотя поисковики самостоятельно определяют важность страниц, указание приоритета в sitemap.xml служит дополнительным ориентиром. Поэтому поисковые будут тратить краулинговый бюджет на нужные страницы, а не мусорные или служебные.

Краулинговый бюджет — это количество страниц сайта, которое сканирует поисковой робот (краулер) поисковых систем. Он необходим для обеспечения эффективной индексации страниц, а именно: защиты от появления «мусорных» страниц, вывода новых материалов и страниц в поиск, предотвращения перегруза серверов.

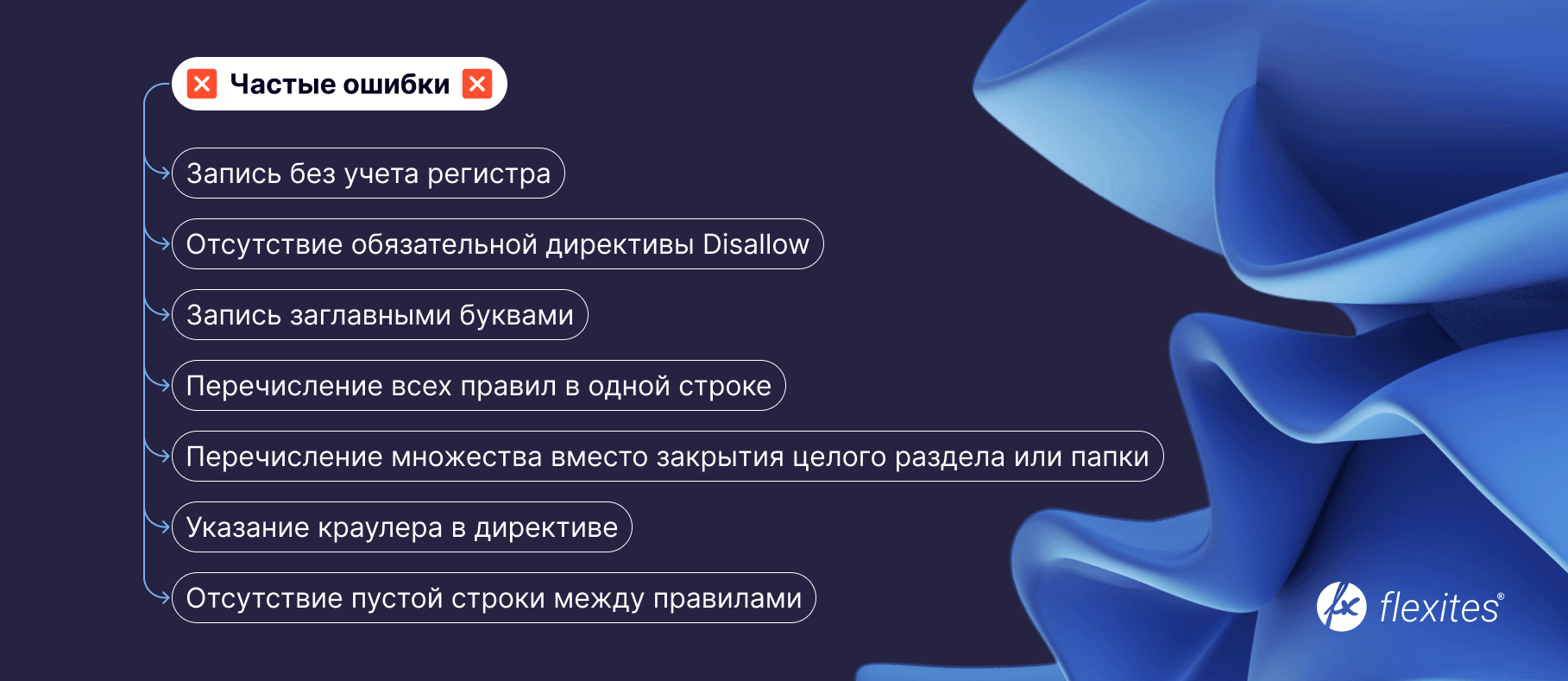

Отсутствие этих файлов или их некорректная настройка — это не просто техническая недоработка, а прямая угроза видимости сайта. Риск индексационного хаоса приводит зачастую к появлению в выдаче ненужных или дублированных страниц, и в то же время потере индексации для важных. Также, появляются скрытые «ловушки» в виде незаметных ошибок индексации, которые со временем перетянут на себя значительную часть трафика.

robots.txt и sitemap.xml — это фундаментальные элементы технической работы любого сайта. Их правильная настройка не требует больших затрат, но обеспечивает защиту конфиденциальности данных и предотвращает путаницу в поисковой выдаче, отображая самую актуальную и полезную информацию. В результате самые важные разделы вашего сайта быстро и правильно попадают в поиск, привлекая целевую аудиторию.

Другие записи

Мы рядом и готовы помочь